在数字时代的浪潮中,算法正以前所未有的速度渗透到社会生活的每一个角落——从精准推送的新闻资讯、个性化定制的购物推荐,到自动化决策的金融信贷、智能匹配的社交网络,算法的触角已经延伸到人类认知与行为的深层领域。这种被称为“算法无限扩张”的技术现象,正在引发一场关于人类自由本质的深刻辩论:算法究竟是解放人类潜能的工具,还是编织新型控制网络的无形枷锁?

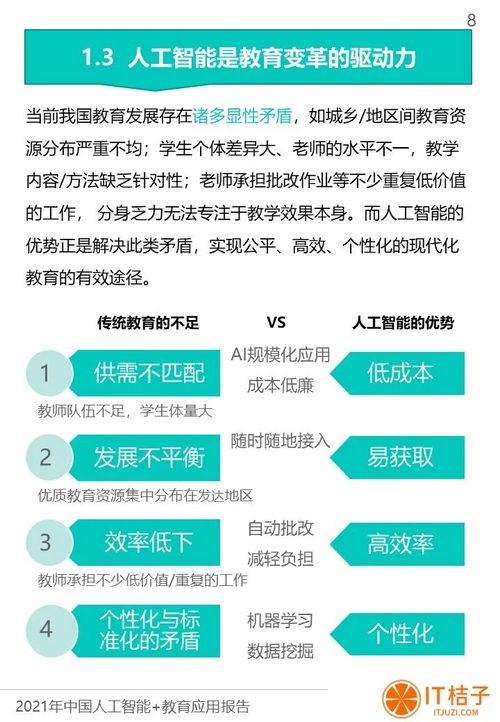

从技术服务的理想图景来看,算法的扩张确实带来了某种“量化自由”。通过高效处理海量数据,算法能够突破人类认知的局限性,提供传统社会难以企及的便利性与多样性。外卖平台算法优化配送路径,让美食触手可及;在线教育算法适配学习路径,突破地域教育资源不均;医疗诊断算法辅助早期筛查,提升生命健康保障。这种以提升效率为核心的“服务逻辑”,创造了技术乌托邦的想象——算法作为中立工具,通过精准计算最大程度满足个体需求,似乎正在实现启蒙运动以来“通过理性获得自由”的技术版本。

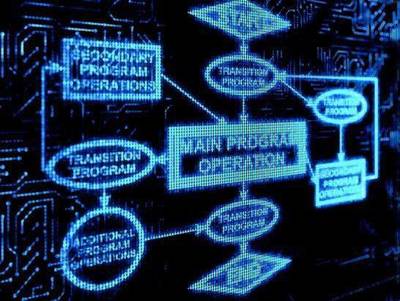

当算法从“服务工具”演变为“社会架构师”,其技术逻辑开始显现出异化的阴影。算法的无限扩张往往伴随着三个层面的结构性枷锁:

首先是认知茧房的隐性控制。基于用户历史行为训练的推荐算法,倾向于强化已有偏好,形成信息过滤气泡。这种“投其所好”的机制表面上尊重个体选择,实则通过循环反馈不断窄化认知视野。当算法比用户更了解其潜在偏好时,自由选择逐渐让位于被精心设计的“推荐自由”,个体在享受便利的无形中交出了思想多样性的主权。

其次是算法歧视的系统性压迫。训练数据中的社会偏见会被算法放大固化,导致资源分配的新型不公。招聘算法可能强化性别歧视,信贷算法可能复制阶级差异,司法风险评估算法可能延续种族偏见。当这些决策过程被包装成“客观计算”,歧视性结果反而获得了技术合法性的外衣,形成了比传统偏见更难挑战的系统性枷锁。

最深刻的是存在方式的算法殖民。当算法开始定义什么是“好的生活”(如社交媒体的点赞指标)、什么是“成功路径”(如职场晋升的数字化评估)、什么是“健康标准”(如穿戴设备的数据规范),人类的价值判断和存在意义逐渐被算法指标重新编码。这种“算法治理术”不仅塑造外部行为,更在重构主体的欲望结构和自我认知,自由意志面临着被预制算法框架收编的风险。

技术服务的辩证法正在于此:算法扩张既创造了前所未有的赋能手段,也构建了新型控制机制。问题的关键不在于彻底拒绝算法——这在技术社会化已成既定事实的今天既不现实也不明智——而在于如何建立算法的民主治理框架。这需要从三个维度展开:

在技术设计层面,推动“价值敏感设计”,将公平、透明、问责等伦理原则嵌入算法架构,发展可解释AI打破算法黑箱;在制度规范层面,建立算法影响评估制度,完善数据权利保护,赋予用户算法选择权与拒绝权;在社会文化层面,培育算法素养教育,鼓励公众参与算法治理讨论,保持对技术决定论的批判性自觉。

算法的未来不应是“无限扩张”的野蛮生长,而应是“有界服务”的理性发展。真正的技术自由,不在于算法能够为我们做出多少“最优选择”,而在于我们能否在理解算法逻辑的基础上,保留质疑、修正乃至拒绝算法的集体能力。当技术服务不再只是效率工具,而成为塑造人类共同未来的社会契约时,我们或许能在数字时代找到自由的新平衡——既享受算法赋能的翅膀,又不被算法锁链束缚飞翔的方向。

在这个算法日益定义现实的时代,重温康德在启蒙运动中的呼吁显得格外迫切:“要有勇气运用你自己的理智!”只不过今天的挑战在于,我们的理智需要与算法智能展开持续对话,在技术服务的浪潮中,既要善用算法拓展人类可能性,更要警惕算法消解人类自主性。唯有保持这种技术辩证法的清醒,我们才能在算法扩张的时代,真正守护属于人的自由尊严。